🎈4 méthodes de test CRO (alternatives à l'A/B test)

Faire du CRO sans A/B test.

Hello 👋

Ravi de vous retrouver dans cette édition de La Cargaison, ici on parle CRO & UX pour faire grimper vos conversions.

Aujourd’hui, on voit comment faire du CRO sans A/B Test, pour les sites avec peu d’utilisateurs.

Devez expert CRO et optimisez n’importe quel site avec la Formation CRO

Boostez vos conversions avec notre accompagnement d’audit CRO

4 méthodes de tests CRO (alternatives à l’A/B Test)

88 % des sites web ne peuvent pas effectuer d’A/B tests.

C’est une moyenne.

Si on vise un MDE de 5 % (ce qu’on vise habituellement), avec un taux de conversion entre 2 % et 5 %, on a besoin de +200 000 visiteurs par mois (sur la page à tester).

Est-ce que cela veut dire qu’on ne peut pas optimiser le taux de conversion ? Non.

Il y a 2 alternatives ici :

1 - Faire des changements beaucoup plus importants

Le but ici est de viser des augmentations de +30 % (MDE plus élevé).

Mais ne faites pas de petits changements. Intégrez toutes vos hypothèses d’un coup.

Ensuite, observez le changement dans GA, en étant bien conscient des facteurs saisonniers et du fait que ce n’est pas parfaitement significatif.

2 - Faire un MAXIMUM de recherche

C’est la chose la plus importante à faire.

Mettez en œuvre des méthodes de recherche puissantes et variées afin d’en générer les meilleures hypothèses et optimisations.

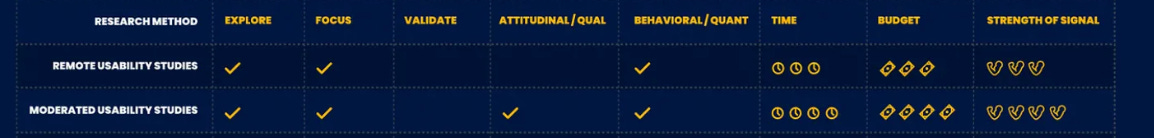

Vous notez que l’A/B testing, en termes de « force de signification » est au-dessus du lot.

Que faire pour se rapprocher le plus de l’A/B testing en termes de puissance de validation ?

Voici 4 méthodes que j’utilise le plus avec mes clients.

1 - Les tests de préférence

Les tests de préférence sont moins puissants que l’A/B testing.

Mais ils ont 5 avantages :

Moins coûteux

Assez rapide à mettre en place

Ne nécessite pas énormément de trafic

Comme l’A/B testing, c’est une méthode de validation

Ils vous permettent de comprendre POURQUOI les utilisateurs préfèrent une variante à une autre (contrairement aux tests A/B)

Comment mettre en place des tests de préférence ?

Des outils comme Lyssna (anciennement UsabilityHub) vous permettent de le faire en suivant ces étapes :

Prenez une capture d’écran de 2 variantes d’une page

Importez-les dans l’outil

Ajoutez une question pour savoir laquelle des variantes est meilleure aux yeux des utilisateurs et POURQUOI elle est meilleure

Vous pouvez obtenir de très bons retours avec 100-200 utilisateurs testés.

2 - A/B Testing X Sessions recordings

Le but ici est de lancer un test A/B non pas pour obtenir des résultats valides, mais uniquement pour déployer les 2 variantes.

Afin que 50 % de vos visiteurs voient chaque variante.

Ensuite, vous pouvez utiliser Hotjar ou Clarity pour utiliser les sessions recordings.

Vous pourrez tirer des observations et des différences de comportement entre les utilisateurs des 2 variantes.

Par exemple, si vous avez fait un changement dans votre menu de navigation, vous allez pouvoir voir si vos utilisateurs semblent mieux interagir avec celui-ci.

Si vous souhaitez intégrer une fonctionnalité, cela vous permettra de voir si les utilisateurs l’utilisent correctement et si ça vaut le coup de l’intégrer officiellement.

3 - A/B Testing X Enquêtes

Vous pouvez faire la même chose ici, mais avec des pop-ups de question.

Le but ici est de poser des questions précises, liées aux changements que vous avez faits entre les 2 variantes.

Par exemple, si vous avez modifié les photos d’une page produit, vous pouvez intégrer ce genre de questions :

Les photos sont-elles suffisantes pour passer à l’achat ?

Pensez-vous qu’il faille ajouter d’autres photos ?

Les photos sont-elles de bonne qualité ?

Là encore, avec +70 réponses, vous pouvez commencer à alimenter des hypothèses pertinentes.

4 - A/B Testing X Test utilisateur

En termes de « puissance de recherche », les tests utilisateurs se positionnent très haut.

Même s’ils ne permettent pas de valider à 100% des hypothèses, ils sont très efficaces pour identifier des problèmes d’UX sur un site web.

Là encore, vous pouvez combiner ça à l’A/B testing, avec des outils comme Userfeel.

Pour faire ça, lors de la configuration du test utilisateur, vous allez devoir ajouter un paramètre pour comparer les 2 variantes.

Ensuite, il vous faut poser des questions plutôt classiques qu’on a l’habitude de poser dans des tests utilisateur.

Y a-t-il quelque chose qui vous gêne sur la page ?

Manque-t-il quelque chose que vous aimeriez voir ?

Quelle version serait la plus susceptible de vous faire passer à l’action ?

Encore une fois, soyez conscient que les réponses obtenues ne reflètent pas parfaitement la réalité.

On retrouve très souvent une différence entre ce que les utilisateurs disent et ce qu’ils font.

Identifier un gagnant

En faisant une synthèse des infos récoltées, vous devriez pouvoir identifier laquelle des variantes pourrait mieux performer en termes de taux de conversion.

Après avoir intégré les modifications, soyez attentif à Google Analytics (ou autre) et regardez si vous voyez une grosse différence en termes de taux de conversion, en utilisant les segments et en ayant conscience du facteur saisonnier.

Bien sûr, la conclusion tirée n’est pas significative statistiquement parlant et aura toujours moins de valeur qu’un test A/B.

Mais c’est la meilleure chose à faire quand vous n’avez pas le trafic nécessaire pour l’A/B testing.

Si vous avez des questions, n’hésitez pas en réponse à ce mail, je réponds à tout le monde :)

À très bientôt,

Florent

Merci pour le contenu,

j'aurais bien aimé connaître tes outils d'A/B testing en amont d'Hotjar et Clarity